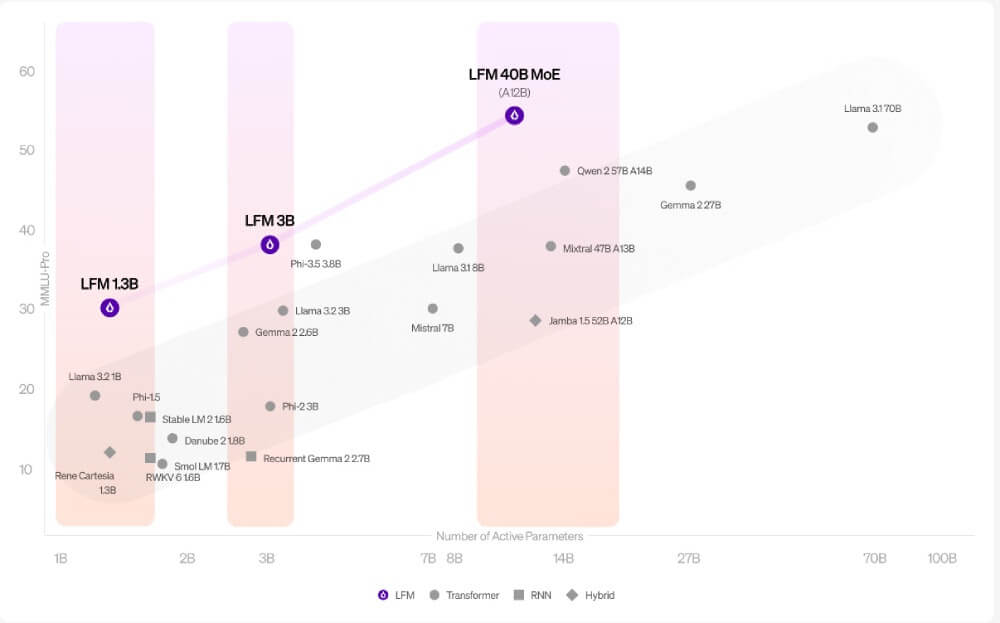

In der Welt der künstlichen Intelligenz zeichnet sich ein bemerkenswerter Wandel ab. Die Liquid Foundation Models (LFMs) brechen mit traditionellen Transformer-Modellen und bieten eine innovativere Architektur für skalierbare, effiziente, und multi-modale generative KI.

Die LFMs von Liquid AI ermöglichen die native Unterstützung verschiedener Datenmodalitäten wie Text, Audio, Bilder und Video. Dies wird durch eine robuste Featurisierungsarchitektur erreicht, die es erlaubt, unterschiedliche Datentypen in einem einheitlichen Rahmen zu verarbeiten. Diese umfassende Verarbeitung unter einem Dach hebt LFMs von ihren Vorgängern ab und beschleunigt die Ausführung komplexer Aufgaben.

Ein entscheidender Aspekt der LFMs ist ihre Fähigkeit zur effizienten Konfiguration und Anpassung auf einer Vielzahl von Hardwareplattformen. Die gezielte Optimierung für den Einsatz auf Edge-Geräten, in Cloud-Umgebungen sowie auf spezialisierten Hardware-Komponenten wie GPUs und AI-Beschleunigern ebnet den Weg für eine reibungslose Integration in zahlreiche Deployment-Umgebungen. Diese Vielseitigkeit prädestiniert die LFMs für den Einsatz in realen Anwendungen und eröffnet neue Horizonte für die Effizienz in der KI-Nutzung.

Die ambitionierte technische Grundlage der LFMs zeichnet sich durch spezialisierte Einheiten für Token- und Kanal-Mischung aus, die effiziente Informationsströme sicherstellen. Dieses Design reduziert die Zahl der erforderlichen Berechnungen pro Aufgabe signifikant, was sowohl die Trainings- als auch die Inferenzzeiten verkürzt. Dies führt zu einer schnelleren Iteration von Modellen, einer raschen Implementierung neuer Merkmale und einer optimierten Feedback-Schleife für kontinuierliche Verbesserungen.

Eingebettet in eine Skalierbarkeit und Flexibilität, die Unternehmen dabei unterstützt, ihre KI-Prozesse effizient zu erweitern, bieten LFMs eine Lösung für vielseitige Aufgaben. Angesichts der Herausforderung, Aufgaben zu bewältigen, die verschiedene Datentypen umfassen, bieten LFMs eine kosteneffiziente Alternative zu herkömmlichen Sprachmodellen. Der nachhaltige Betrieb durch reduzierte Energieaufnahme könnte zudem zur Senkung der Betriebskosten beitragen, was insbesondere für Unternehmen von Bedeutung ist, die ihre Umweltauswirkungen minimieren möchten.

Die wichtigsten Fakten zum Update:

- LFMs bieten native Unterstützung für mehrere Datenmodalitäten durch eine einheitliche Architektur.

- Optimierungen für verschiedene Hardwareumgebungen gewährleisten eine breite Einsatzmöglichkeit.

- Die Architektur reduziert den Rechenaufwand, was zu schnelleren Trainings- und Inferenzzeiten führt.

- LFMs überzeugen durch Skalierbarkeit und Flexibilität, besonders für reale Anwendungen.

- Obwohl derzeit nicht Open-Source, folgt Liquid AI einer offenen Wissenschaftsphilosophie mit Zukunftsplänen, relevante Daten zugänglich zu machen.

Die Entwicklung der Liquid Foundation Models representiert einen bedeutenden Fortschritt für die KI-Branche. Die erweiterten Fähigkeiten und effizienten Ressourcennutzungen dieser Modelle bieten vielversprechende Möglichkeiten für Unternehmen, geben jedoch auch Anlass zur Diskussion über eine breitere Implementierung und die Sicherstellung von Kompatibilitäten innerhalb bestehender technologischer Strukturen.

Quellen: Liquid Foundation Models

Florian Schröder ist Experte im Online-Marketing mit Schwerpunkt PPC (Pay-Per-Click) Kampagnen. Die revolutionären Möglichkeiten der KI erkennt er nicht nur, sondern hat sie bereits fest in seine tägliche Arbeit integriert, um innovative und effektive Marketingstrategien zu entwickeln.

Er ist überzeugt davon, dass die Zukunft des Marketings untrennbar mit der Weiterentwicklung und Nutzung von künstlicher Intelligenz verbunden ist und setzt sich dafür ein, stets am Puls dieser technologischen Entwicklungen zu bleiben.