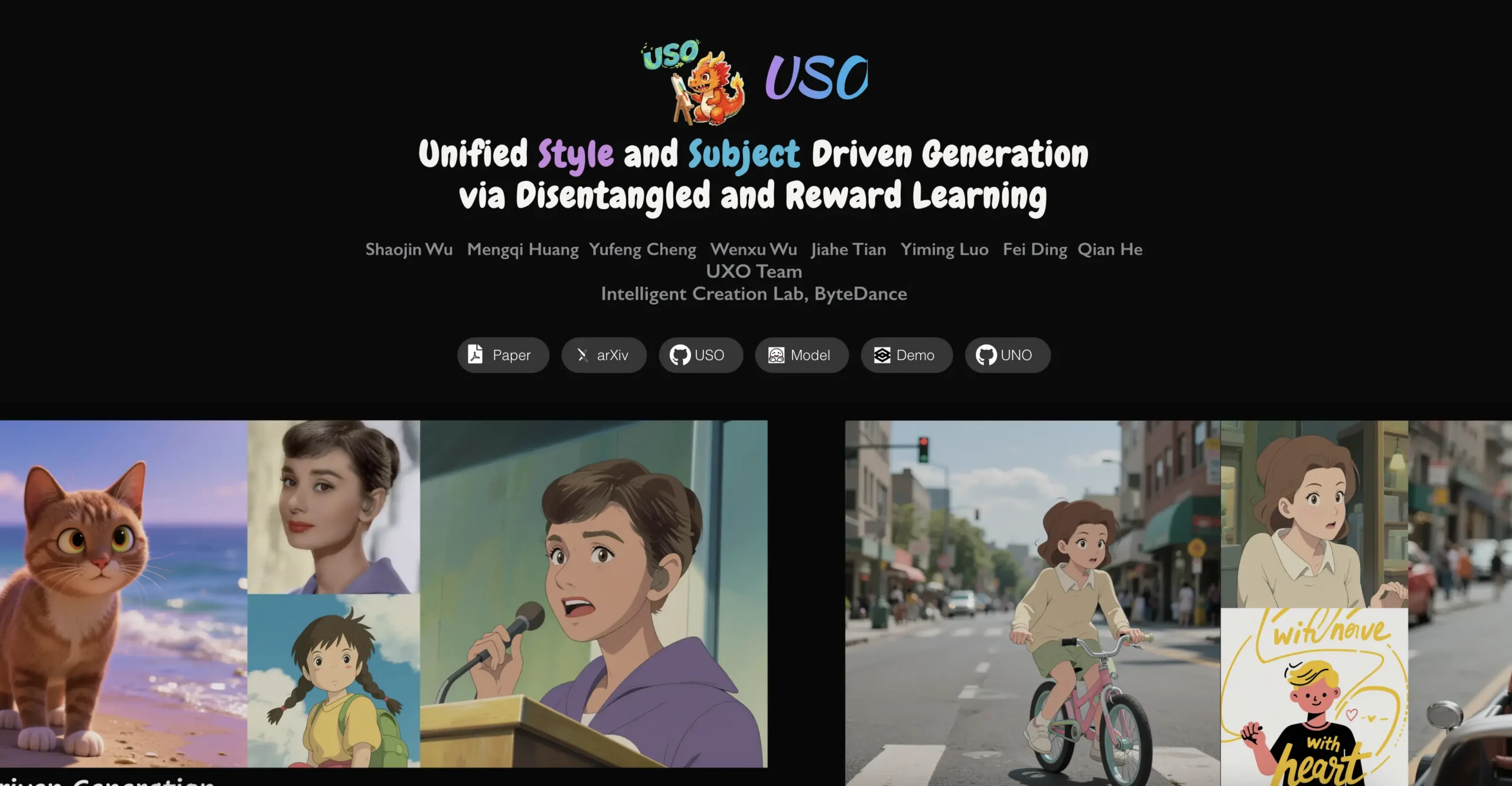

ByteDance transformiert die Bildgenerierung durch ein wegweisendes Framework, das zwei bisher getrennte KI-Bereiche erfolgreich zusammenführt. Das neue System namens USO (Unified Style and Subject-Driven Generation) stellt einen fundamentalen Paradigmenwechsel dar und erzielt State-of-the-art Ergebnisse bei der gleichzeitigen Kontrolle von Stil und Subjektmerkmalen.

Die UXO Team Intelligent Creation Lab von ByteDance veröffentlichte im August 2025 ein Framework, das eine jahrelange Herausforderung der KI-Bildgenerierung löst. Traditionell wurden stilgesteuerte und subjektgesteuerte Generierung als konkurrierende Aufgaben behandelt, wobei Optimierungen in einem Bereich typischerweise zu Verschlechterungen im anderen führten. USO demonstriert jedoch, dass diese Aufgaben sich gegenseitig verstärken können, wenn sie durch innovative Cross-Task-Co-Disentanglement-Techniken vereint werden.

Das System basiert auf einer MM-DiT-Architektur (Multimodal Diffusion Transformer) mit einem neuartigen einheitlichen Aufmerksamkeitsmechanismus. Anstelle traditioneller Kreuzaufmerksamkeit zwischen Modalitäten verknüpft USO alle Eingabe-Token – Text, Stil, Inhalt und verrauschte Latente – in einer einheitlichen Sequenz, die durch gemeinsame Selbstaufmerksamkeit verarbeitet wird.

Technische Innovationen und Leistungsdaten

Das zweistufige progressive Training von USO adressiert die Optimierungsprobleme, die bisherige einheitliche Ansätze limitierten. Stufe 1 (Style Alignment Training) fokussiert ausschließlich auf die Ausrichtung von Stilmerkmalen mit vorhandenen Textverarbeitungsfähigkeiten. Stufe 2 (Content-Style Disentanglement Training) führt die volle Komplexität der gemeinsamen Stil-Subjekt-Generierung ein, während die in Stufe 1 erreichte stabile Grundlage beibehalten wird.

Die Leistungsergebnisse auf dem DreamBench-Evaluationsdatensatz demonstrieren die Überlegenheit des Ansatzes. USO erreicht den höchsten gemeldeten DINO-Ähnlichkeitsscore von 0.777 und einen CLIP-I-Score von 0.838, was erhebliche Verbesserungen gegenüber bisherigen State-of-the-art-Methoden darstellt. Der CLIP-T-Score von 0.317 bestätigt eine starke Text-Bild-Ausrichtung bei gleichzeitiger Bewahrung der Subjektmerkmale.

Das Framework nutzt für die Stilverarbeitung den SigLIP-Encoder anstelle traditioneller VAE-Encoder – eine entscheidende Design-Entscheidung für die Erfassung reichhaltigerer, abstrakterer Stilhinweise. Inhaltsbilder durchlaufen eine separate Verarbeitungspipeline mit einem eingefrorenen VAE-Encoder, der für die Bewahrung von Subjektidentität und strukturellen Informationen optimiert wurde.

Cross-Task-Triplet-Datensatz und Evaluation

Die Entwicklung des USO-Datasets mit etwa 200.000 sorgfältig kuratierten Triplets stellt den ersten groß angelegten Datensatz dar, der speziell für einheitliche Stil-Subjekt-Generierung entwickelt wurde. Das innovative Cross-Task-Triplet-Curation-Framework generiert umfassende Trainingsdaten im Format ⟨Stilreferenz, Inhaltsreferenz, stilisiertes Ziel⟩ durch zwei spezialisierte Expertenmodelle.

USO-Bench etabliert den ersten umfassenden Benchmark für die gemeinsame Bewertung von Stilähnlichkeit und Subjekttreue. Die Benchmark-Evaluationsmethodik umfasst drei verschiedene Aufgabenbereiche: reine subjektgesteuerte Generierung, reine stilgesteuerte Generierung und gemeinsame Stil-Subjekt-Szenarien. Die Bewertungsmetriken decken multiple Dimensionen der Generierungsqualität ab und adressieren sowohl objektive als auch subjektive Aspekte der Bildgenerierung.

Das Style Reward Learning (SRL) Paradigma bietet zusätzliche Supervision zur Verbesserung der Modellleistung bei Stiltreue und Subjektkonsistenz. Stilähnlichkeits-Belohnungen nutzen dichte Einbettungen spezialisierter Stil-Encoder für kontinuierliches Feedback zur stilistischen Ausrichtung, während Subjektkonsistenz-Belohnungen etablierte Metriken wie CLIP-I- und DINO-Ähnlichkeitsmaße einsetzen.

Praktische Anwendungen und Zukunftsperspektiven

Die einheitlichen Fähigkeiten von USO ermöglichen ein breites Spektrum praktischer Anwendungen, die zuvor schwierig oder unmöglich zu realisieren waren. Kreative Inhaltsgenerierung profitiert besonders von der Möglichkeit, Subjekte in völlig neue Kompositionen zu repositionieren, während sowohl Identitäts- als auch Stilkonsistenz beibehalten werden. Dies erweist sich als besonders wertvoll für Storytelling-Anwendungen, wo konsistente Charaktere in verschiedenen stilistischen Kontexten erscheinen müssen.

Kommerzielle Designanwendungen nutzen USOs einheitlichen Ansatz für Szenarien, die Markenkonsistenz über verschiedene visuelle Stile hinweg erfordern. Marketing-Kampagnen können kohärente visuelle Inhalte effizient generieren, während sie sich an unterschiedliche ästhetische Kontexte anpassen. Die Echtzeit-Generierungsfähigkeiten machen das Framework für interaktive Anwendungen geeignet, wo Benutzer verschiedene stilistische Optionen erkunden können.

Die Open-Source-Verfügbarkeit des Frameworks stellt sicher, dass diese Fortschritte der breiteren Forschungsgemeinschaft zugutekommen, während kollaborative Verbesserung und Anpassung gefördert werden. Speicheroptimierungsstrategien einschließlich fp8-Quantisierungsmodi reduzieren den Spitzenspeicherverbrauch auf etwa 16GB und ermöglichen den Zugang zu fortgeschrittenen Generierungsfähigkeiten auf Consumer-Hardware.

Zusammenfassung

- ByteDance veröffentlicht USO-Framework für einheitliche Stil- und Subjekt-gesteuerte Bildgenerierung mit State-of-the-art Performance

- Innovative MM-DiT-Architektur mit einheitlichem Aufmerksamkeitsmechanismus vereint erstmals zwei bisher konkurrierende KI-Bereiche erfolgreich

- Zweistufiges progressives Training löst Optimierungskonflikte durch Style Alignment Training und Content-Style Disentanglement Training

- Neue Benchmark-Rekorde mit DINO-Score 0.777 und CLIP-I-Score 0.838 bei gleichzeitig starker Text-Bild-Ausrichtung

- USO-Bench etabliert ersten umfassenden Evaluationsstandard für gemeinsame Bewertung von Stilähnlichkeit und Subjekttreue

- 200.000 kuratierte Triplets im USO-Dataset ermöglichen robuste Generalisierung über verschiedene Anwendungsdomänen

- Open-Source-Verfügbarkeit und Speicheroptimierung demokratisieren Zugang zu fortgeschrittenen Generierungsfähigkeiten auf Consumer-Hardware

Quelle: GitHub

Florian Schröder ist Experte im Online-Marketing mit Schwerpunkt PPC (Pay-Per-Click) Kampagnen. Die revolutionären Möglichkeiten der KI erkennt er nicht nur, sondern hat sie bereits fest in seine tägliche Arbeit integriert, um innovative und effektive Marketingstrategien zu entwickeln.

Er ist überzeugt davon, dass die Zukunft des Marketings untrennbar mit der Weiterentwicklung und Nutzung von künstlicher Intelligenz verbunden ist und setzt sich dafür ein, stets am Puls dieser technologischen Entwicklungen zu bleiben.